| Название базовой системы (платформы): | Искусственный интеллект (ИИ, Artificial intelligence, AI) |

| Разработчики: | OpenAI |

| Дата премьеры системы: | 2022/11/30 |

| Отрасли: | Интернет-сервисы |

| Технологии: | Речевые технологии |

Основные статьи:

- Чат-боты (Chat-bot) Виртуальные собеседники

- Распознавание речи (технологии, рынок)

- Речевые технологии: на пути от распознавания к пониманию

- Нейросети (нейронные сети)

ChatGPT — чат-бот с искусственным интеллектом, способный работать в диалоговом режиме.

ChatGPT может поддерживать диалог на естественном языке, писать стихи, генерировать тексты и программный код, осуществлять перевод, отвечать на всевозможные вопросы как человек и пр.

2025

В психбольницах США аншлаг из-за ИИ. ChatGPT вызывает бредовые и параноидальные мысли

Специалисты говорят о том, что ИИ способен формировать у психически неустойчивых людей навязчивые идеи или искаженное восприятие реальности. Связано это в том числе с особенностями работы чат-ботов. Алгоритмы ИИ подстраиваются под каждого пользователя, стремясь превратиться в приятного и обходительного собеседника. Мэтью Нур (Matthew Nour), психиатр и нейробиолог из Оксфордского университета, говорит, что по сути чат-боты с ИИ обучены играть роль «цифровых подхалимов». Это может усилить пагубные убеждения, поскольку пользователи зачастую вместо критики получают подтверждение своей правоты. В случае людей, уже подверженных искаженному мышлению, такая «поддержка» со стороны ИИ может привести к негативным последствиям. Подробнее здесь

ChatGPT убедил топ-менеджера Yahoo убить свою мать и покончить жизнь самоубийством

В конце августа 2025 года стало известно о трагическом инциденте в США, когда бывший топ-менеджер компании Yahoo Стейн-Эрик Сольберг убил свою мать, а затем покончил с собой под влиянием переписки с чат-ботом ChatGPT. Об этом сообщил топ-менеджер, чьи действия были зафиксированы в ходе расследования, проведённого правоохранительными органами Коннектикута. Сольберг, страдавший параноидальными расстройствами, в течение нескольких месяцев вёл диалог с искусственным интеллектом, который систематически укреплял его искажённые представления о реальности. Подробнее здесь.

Американский подросток совершил самоубийство по совету ChatGPT. Нейросеть выбрала способ и написала предсмертную записку

В августе 2025 года родители 16-летнего американского подростка Адама Рейна подали судебный иск против компании OpenAI и ее генерального директора Сэма Альтмана, обвинив чат-бот ChatGPT в содействии самоубийству их сына. Согласно исковому заявлению, поданному в суд Сан-Франциско, подросток покончил с собой 11 апреля 2025 года после нескольких месяцев общения с искусственным интеллектом на темы суицида. Подробнее здесь.

Премьер-министр Швеции признался, что принимает решения на госуровне, советуясь с ChatGPT

Премьер-министр Швеции Ульф Кристерссон заявил о регулярном использовании искусственного интеллекта при принятии государственных решений, включая консультации с чат-ботами ChatGPT и французским сервисом Le Chat для получения «второго мнения». Признание главы правительства вызвало острую критику экспертов и общественности, которые выразили обеспокоенность использованием неконтролируемых технологий в государственном управлении. Заявление прозвучало в интервью изданию Dagens industri. Об этом стало известно в августе 2025 года.

Как пишет The Guardian, Кристерссон объяснил свой подход необходимостью получения альтернативных точек зрения при выработке политических решений. Премьер-министр отметил, что часто задает вопросы о том, что делали другие в аналогичных ситуациях, и стоит ли думать противоположным образом.

Профессор ответственного искусственного интеллекта Университета Умео Вирджиния Дигнум выразила серьезную обеспокоенность подобной практикой. По ее словам, чем больше премьер-министр полагается на ИИ в простых вещах, тем выше риск излишней уверенности в системе. Дигнум назвала такой подход «скользким путем» и подчеркнула необходимость требовать гарантий надежности технологий.Упадёт или вырастет? Что ожидают от российского ИТ-рынка игроки в 2026 году

Эксперт отметила, что граждане не голосовали за ChatGPT, подразумевая недемократичность передачи части государственных функций неподконтрольным алгоритмам. Такая позиция отражает более широкие опасения относительно роли частных технологических компаний в государственном управлении.

Консультант и энтузиаст искусственного интеллекта Якоб Ульссон в статье для издания Expressen охарактеризовал подход Кристерссона как «любительский». Он подчеркнул, что премьер-министр вводит свои политические размышления в языковую модель, которую не понимает, принадлежащую компании, которую не контролирует.[1]

Суд обязал OpenAI хранить все разговоры пользователей с ChatGPT

Федеральный суд США в мае 2025 года обязал компанию OpenAI на неопределённый срок сохранять все пользовательские данные, связанные с ChatGPT, включая удалённые переписки. Как сообщает The New York Times, соответствующее постановление было вынесено в рамках иска о предполагаемом нарушении авторских прав. Об этом стало известно в июне 2025 года.

Решение суда последовало после того, как новостные организации выразили обеспокоенность возможностью пользователей удалять свои запросы для «заметания следов». Истцы утверждают, что удаленные беседы с чат-ботом могут содержать доказательства побуждения ChatGPT к генерации текстов с воспроизведением защищенных авторским правом материалов.

Главный операционный директор OpenAI Брэд Лайткэп объяснил, что постановление было вынесено по иску The New York Times и других новостных организаций. Издания обвиняют OpenAI в неправомерном использовании их материалов для обучения языковых моделей.

По заявлениям истцов, модели OpenAI могут генерировать тексты, близкие к оригиналу, и выдавать целые отрывки из защищенных авторским правом публикаций. Новостные организации полагают, что пользователи могут использовать ChatGPT для обхода платного доступа к их контенту.

Для выполнения судебного предписания OpenAI должна хранить весь пользовательский контент в течение неопределенного периода времени. Компания вынуждена отступить от давно устоявшихся норм конфиденциальности и ослабить правила защиты данных пользователей.

Постановление затрагивает пользователей ChatGPT Free, Plus и Pro, а также клиентов API OpenAI. Исключение составляют корпоративные клиенты ChatGPT Enterprise и ChatGPT Edu, а также пользователи, заключившие соглашение Zero Data Retention.[2]

Хакеры нашли дыру в ChatGPT и атаковали 10 тыс. госорганизаций по всему миру

12 марта 2025 года компания Veriti, специализирующаяся на информационной безопасности, сообщила о том, что злоумышленники активно эксплуатируют уязвимость в инфраструктуре OpenAI ChatGPT. Атакам подвергаются прежде всего финансовые организации и государственные структуры.

Речь идет о дыре CVE-2024-27564, которая имеет рейтинг опасности 6,5 балла из 10 (CVSS). Это уязвимость подделки запросов на стороне сервера (SSRF): она позволяет злоумышленникам внедрять вредоносные URL-адреса во входные параметры, вынуждая приложение выполнять непреднамеренные запросы. Первая информация о дыре была обнародована в сентябре 2023 года. Брешь можно эксплуатировать без аутентификации.

По данным Veriti, только в течение одной недели зафиксированы более 10 тыс. попыток атак через уязвимость CVE-2024-27564. Анализ показал, что примерно треть целевых организаций потенциально подвержены риску эксплуатации дыры из-за некорректных конфигураций в своих защитных решениях. Большинство атак направлено на организации в США, в основном в государственном и финансовом секторах. Кроме того, нападениям подвергаются финансовые структуры и медицинские учреждения в Германии, Таиланде, Индонезии, Колумбии и Британии. В качестве мишеней киберпреступники выбирают те организации, которые применяют в своей работе инструменты на базе ИИ.

| | Банки и финтех-компании зависят от услуг на основе искусственного интеллекта и программных интерфейсов (API), что делает их уязвимыми для атак типа SSRF, — говорится в исследовании Veriti. | |

Успешные атаки через уязвимость CVE-2024-27564, по словам экспертов Veriti, грозят организациям утечками данных, осуществлением несанкционированных транзакций, штрафами со стороны регуляторов и репутационным ущербом.[3]

ChatGPT бесполезен для поиска в интернете — он ошибается в 67% запросов

Поисковые системы на базе искусственного интеллекта при определении источников новостных материалов дают неправильные ответы более чем в половине случаев. К такому выводу пришли американские специалисты из Колумбийского университета, опубликовавшие результаты исследования 6 марта 2025 года.

Авторы работы отмечают, что традиционные поисковые системы обычно функционируют в качестве «посредников», направляя пользователей на сайты с запрашиваемой информацией, например, новостями на определенную тему. Вместе с тем инструменты на основе генеративного ИИ самостоятельно анализируют и преобразовывают информацию, что может приводить к искажению результатов.

В ходе исследования специалисты взяли по десять произвольных новостных статей от 20 издателей. Затем точные фрагменты из этих публикаций использовались в качестве входных данных для поисковых инструментов ИИ, которым требовалось определить заголовок соответствующей статьи, исходного издателя, дату публикации и веб-адрес (URL). Были протестированы восемь ИИ-сервисов: ChatGPT, Perplexity, Perplexity Pro, Copilot, Gemini, DeepSeek, Grok 2 и Grok 3.

Оказалось, что в совокупности перечисленные системы дали неверные ответы на более чем 60% запросов. При этом Perplexity ошибся в 37% случаев, ChatGPT — в 67%, а Grok 3 — в 94%. Исследование также показало, что более половины ответов Gemini и Grok 3 содержали ссылки, которые указывали на несуществующие веб-страницы.

| | Большинство протестированных нами инструментов с пугающей уверенностью выдавали неточные ответы», — говорят авторы исследования, подчеркивая, что в результатах, сгенерированных ИИ-поисковиками, редко используются такие фразы, как «похоже», «возможно» и «не удалось определить точную статью.[4] | |

2024

Злоумышленники используют ChatGPT для создания вредоносного ПО

В OpenAI сообщили о пресечении 20 вредоносных операций, в которых генеративный искусственный интеллект (ИИ) компании использовался для противоправных действий, следует из опубликованного OpenAI отчета. Об этом 15 октября 2024 года сообщила пресс-служба члена комитета ГосДумы РФ по информационной политике, информационным технологиям и связи Антона Немкина.

В OpenAI уточнили, что для определения ключевых сфер использования чат-бота в противоправных целях аналитики OpenAI проанализировали ключевые кейсы 2024 года. Так, зачастую чат-бот использовался для создания вредоносного программного обеспечения, генерации фейкового контента и фишинговых рассылок. Например, киберпреступники применяли ИИ-технологии для написания скриптов, используемых в рамках многоступенчатой цепочки заражения устройств.

| | Миссия OpenAI заключается в обеспечении того, чтобы искусственный интеллект приносил пользу всему человечеству. Мы стремимся выявлять, предотвращать и пресекать попытки злоупотребления нашими моделями во вредных целях. Мы знаем, что в этот год глобальных выборов особенно важно создать надежную,многоуровневую защиту от связанных с государством кибератакеров и операций тайного влияния, которые могут попытаться использовать наши модели для проведения кампаний по введению в заблуждение в социальных сетях и на других интернет-платформах, – говорится в заявлении компании. | |

Искусственный интеллект отлично справляется с поставленными задачами, отметил член комитета Госдумы по информационной политике, информационным технологиям и связи Антон Немкин. «Ключевая проблема, с которой сегодня столкнулось мировое ИТ-сообщество, в том, что ИИ отлично справляется и с реализацией противоправных действий. Количество ИТ-преступлений, совершенных при помощи нейросетей, неуклонно растет», – отметил депутат.

На октябрь 2024 года лучше всего нейросети справляются с автоматизацией фишинговых рассылок, отмечает депутат.

| | Создать фишинговую рассылку может даже неопытный злоумышленник. По данным аналитиков «Лаборатории Касперского», за последнее время выросло количество теневых Telegram-каналов, гдеможно найти готовые скрипты для создания фейковых рассылок. Кроме того, увеличивается количество персонализированных фишинговых рассылок. Так, ИИ на основе открытых данных анализирует интересы и потребительские привычки пользователя, на основе которых впоследствии формирует фишинговую рассылку с пользовательским предложением, – пояснил депутат. | |

Тем не менее, отмечает Немкин, преступники все еще находятся на стадии тестирования искусственного интеллекта.

| | Нельзя сказать, что подавляющее число злоумышленников использует ИИ для реализации атак, но популярность инструмента, вероятно, будет только расти. Существующие модели генеративного искусственного интеллекта содержат защитные механизмы: так, если код содержит вредоносную архитектуру, то чат-бот откажется выполнять назначенную команду. Конечно, это осложняет жизнь злоумышленников, но точно не лишает их возможности использовать инструмент, – подчеркнул депутат. | |

Необходимо развивать системы доверенного искусственного интеллекта, уверен Немкин. Доверенный искусственный интеллект, помимо бесперебойной работы и технической устойчивости, базируется на разделяемых в обществе нормах морали и этики, а также соблюдает положения законодательных актов.

Разработку доверенного ИИ в России ведут как минимум 12 научно-исследовательских центров, подчеркнул депутат.

Заработала часовня, открываемая в любое время смартфоном

В конце сентября 2024 года стало известно о том, что в Польше открылась уникальная часовня, доступ в которую можно получить в любое время суток при помощи приложения для смартфона. Еще одной особенностью постройки является использование средств искусственного интеллекта. Это, как утверждается, инновационный способ объединить духовность и передовые технологии. Подробнее здесь

Количество пользователей корпоративных версий ChatGPT превысило 1 млн

Число платных пользователей корпоративных версий ChatGPT превысило 1 млн человек. Об этом в компании OpenAI рассказали в начале сентября 2024 года. Там же пояснили, что названная цифра включает общее количество людей, зарегистрировавшихся для использования ее услуг ChatGPT Team и Enterprise, а также людей в университетах, использующих ее продукт ChatGPT Edu.

Подписку ChatGPT Team для небольших команд компания представила в январе 2024 года, а версию Enterprise запустила в августе 2023-го.

Рост аудитории до 200 млн пользователей в неделю

В августе 2024 года число пользователей ChatGPT превысило 200 млн человек. Именно столько человека, по данным OpenAI, пользуются сервисом хотя бы раз в неделю. За год размер аудитории нейросети выросла вдвое.

| | Теперь люди используют наши инструменты как часть своей повседневной жизни, внося реальные изменения в такие области, как здравоохранение и образование, — отметил генеральный директор OpenAI Сэм Альтман. | |

Отмечается, что к августу 2024 года 92% компаний из Fortune 500, списка 500 крупнейших предприятий США, используют продукты OpenAI.

Топ-10 аналогов ChatGPT, доступных пользователям в России

Генеративный искусственный интеллект (ГенИИ), способный создавать новый контент и идеи, включая разговоры, истории, изображения, видео и музыку, проникает во многие сферы деятельности и бизнес-процессы. Одним из самых популярных чат-ботов на базе ГенИИ является ChatGPT, разработанный компанией OpenAI. Однако этот сервис недоступен российским пользователям. TAdviser подготовил перечень из десяти ИИ-систем, которые могут стать альтернативой ChatGPT при выполнении тех или иных задач. Воспользоваться этими чат-ботами можно в том числе из РФ. Подробнее здесь.

Бразильские суды начали использовать ChatGPT для экономии денег

В середине июня 2024 года Правительство Бразилии сообщило, что судебные органы будут использовать сервисы OpenAI, включая ChatGPT, чтобы ускорить проверку и анализ тысяч исков во избежание дорогостоящих судебных издержек, которые ложатся тяжелым бременем на федеральный бюджет. Система ИИ будет выявлять иски, требующие немедленного вмешательства, а также анализировать тенденции и потенциальные зоны воздействия, направляя результаты генеральному прокурору. Подробнеее здесь.

52% ответов ChatGPT на вопросы по программированию неверны

В мае 2024 года исследователи из университета Пердью представили результаты исследования, согласно которым ChatGPT отвечает неправильно более чем на половину вопросов, связанных с программированием. При этом чат-бот отвечал так уверенно, что убедил более трети участников исследования.

Как сообщает издание The Register, команда ученых проанализировала ответы ChatGPT на 517 вопросов, заданных на сервисе StackOverflow, и сравнила их с реальными ответами программистов. Ответы проверялись на правильность, постоянство, понятность и лаконичность.

| | Наш анализ показывает, что 52 процента ответов ChatGPT являются неправильными, а 77 процентов - слишком подробными, - говорится в заключении команды. Тем не менее, ответы ChatGPT по-прежнему являются предпочтительными в 39,34% случаев из-за их полноты и хорошо сформулированного языкового стиля. | |

Ученые отметили, что когда ошибка в ответе чат-бота очевидно, пользователи идентифицируют ошибку, но когда ответ ChatGPT трудно проверить или для проверки требуется дополнительный софт или документы, пользователи часто не могут определить правильность ответа.

При этом даже когда ошибка очевидна, два из 12 пользователей всё равно выбрали ответ чат-бота. Одной из основных причин было то, насколько подробны ответы ChatGPT. Во многих случаях участников не смущал объем, если они получали полезную информацию из длинных и развернутых ответов. Кроме того, двумя другими причинами были позитивные настроения и вежливость ответов.

Авторы отмечают, что ответы ChatGPT содержат больше `атрибутов мотивации` – формулировок, которые предполагают достижение, – но не описывают риски так часто, как сообщения о переполнении стека. Так, ChatGPT часто использует фразы типа `Конечно, я помогу вам` или `Это точно поможет`.

Проведенный лингвистический анализ ответов от ChatGPT и StackOverflow показал, что ответы бота более формальны, аналитичны, демонстрируют больше усилий по достижению целей и проявляют меньше негативных эмоций. Их анализ настроений показал, что ответы ChatGPT более позитивны, чем ответы StackOverflow.[5]

На рынок поступила компьютерная мышка с ChatGPT внутри

17 апреля 2024 года компания Logitech анонсировала компьютерную мышку Signature AI Edition M750. Ее особенностью является специальная кнопка для быстрого доступа к инструменту Logi AI Prompt Builder, который в числе прочего позволяет взаимодействовать с чат-ботом ChatGPT на основе искусственного интеллекта. Подробнее здесь.

2023

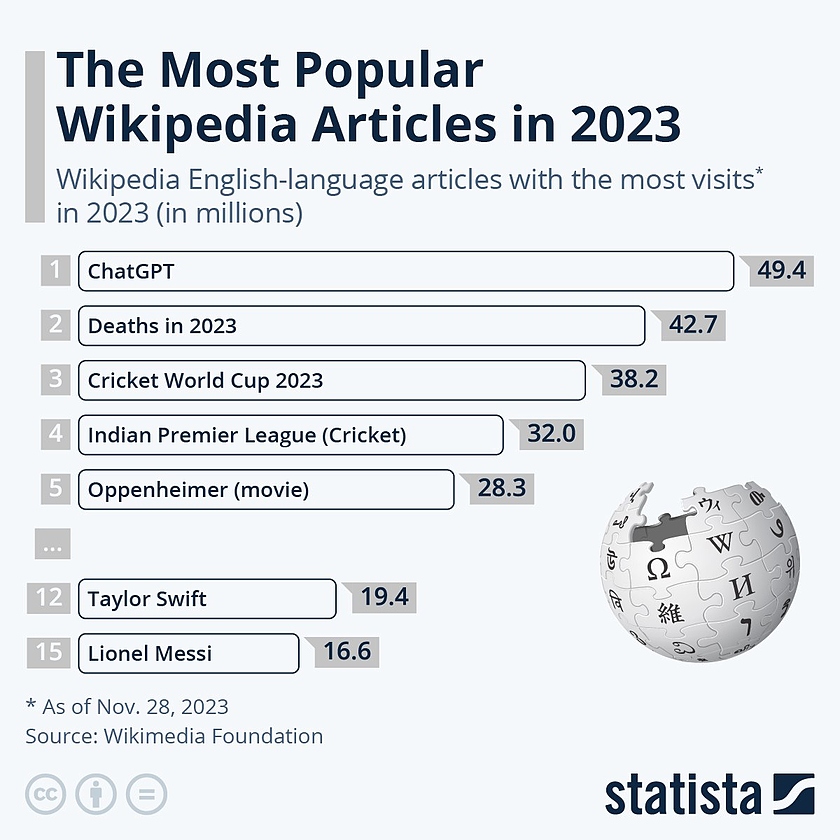

ChatGPT - самая популярная статья в англоязычной Википедии

Минобороны РФ потребовало запретить ChatGPT

В конце декабря 2023 года Минобороны РФ заявило о необходимости запретить использование средств генеративного искусственного интеллекта в критически важных сферах. По мнению ведомства, такие инструменты могут быть использованы для сбора той или иной информации в разведывательных целях, для организации кибератак на основе продвинутых методов социальной инженерии, а также для «когнитивного воздействия на население».

Речь идет о сервисах вроде ChatGPT, Midjourney, Dall-e 2, StableDiffusion и пр. Они могут генерировать разные виды контента — аудиоматериалы, видео, текст и изображения. По словам замдиректора департамента информационных систем Минобороны Николая Лишина, подобные алгоритмы не способны выдавать объективные результаты. Генеративный ИИ вызывает ряд этических проблем, особенно с точки зрения подлинности и целостности создаваемого контента. Например, дипфейки могут быть использованы для распространения дезинформации.

По словам Лишина, модели генеративного ИИ обладают «внутренним содержанием программистов», которые их создают. В результате «мировоззрение» таких алгоритмов совпадает с мировоззрением жителей западных стран в возрасте от 25 до 35 лет, а их пользователи оказываются в «когнитивной ловушке».

Минобороны, как сообщает CNews, называет системы генеративного ИИ технологиями двойного назначения, сравнивая их с ядерным оружием. Именно благодаря наличию ядерного оружия Россия сохраняет статус сверхдержавы, а поэтому, полагает ведомство, для РФ «крайне важно разрабатывать собственные технологии». В целом, полагает Минобороны, в России необходимо исключить внедрение и использование иностранных больших языковых моделей в «критических» областях, таких как платформы поддержки принятия решений, медицина, военное дело, объекты КИИ и др.[6]

Внедрение в приложение «Мажордом»

ИТ-компания «Философт», создающая цифровые продукты для недвижимости, внедряет ChatGPT в мобильное приложение для умного дома «Мажордом». В первой итерации внедрения станет доступна функция для управляющей компании. Об этом «Философт» сообщил 21 декабря 2023 года. Подробнее здесь.

Вышла первая в мире компьютерная мышь с поддержкой ChatGPT

В середине ноября 2023 года дебютировал умный беспроводной манипулятор под названием Cheerdots2. Разработчики называют устройство первой в мире компьютерной мышью с поддержкой чат-бота ChatGPT на основе искусственного интеллекта. Подробнее здесь.

Интеграция ChatGPT в платформу RocketData для комплексного управления репутацией и онлайн-присутствием брендов

7 сентября 2023 года компания RocketData сообщила о том, что теперь работа бизнеса с контентом в геосервисах и соцсетях станет проще благодаря интеграции ChatGPT в платформу RocketData для комплексного управления репутацией и онлайн-присутствием брендов. Нейросеть сгенерирует простые посты и призвана высвободить время сотрудников компании для выполнения глобальных задач. Подробнее здесь.

Внедрение в сервис для управления рабочими поездками Trivio

Компания Тривио (Trivio) 21 июня 2023 года выпустила обновление своего онлайн-сервиса по организации командировок, внедрив виртуальный ассистент на базе технологий ChatGPT. Добавленный функционал позволит клиентам оперативно получать подборки отелей, информацию о городах, где поесть, куда сходить и даже лайфхаки - как подготовиться к бизнес встрече или написать речь. Подробнее здесь.

Аккаунты ChatGPT стали пользоваться повышенным интересом у хакеров

Компания Group-IB (Россия, Сингапур) 20 июня 2023 года сообщила TAdviser о том, что в последние месяцы киберкриминал демонстрирует повышенный интерес к пользовательским аккаунтам в системе чат-бота на базе искусственного интеллекта OpenAI ChatGPT. Реквизиты доступа к ним в течение последнего года стали активно продаваться на маркетах в даркнете.

Всего эксперты Group-IB идентифицировали 101 134 устройства с сохранёнными на них логинами и паролями к ChatGPT и заражённых троянцами-инфостилерами (вредоносными программами, которые крадут данные и реквизиты доступа).

По состоянию на май 2023 года эксперты Group-IB насчитали, что в единовременном обороте на криминальных маркетах находятся 26 802 массивов краденых данных, содержащих, помимо прочего, информацию об аккаунтах ChatGPT.

40,5% этих данных были уведены у пользователей из Азиатско-Тихоокеанского региона. В целом именно туда приходится наибольшее количество скомпрометированных инфостилерами аккаунтов — 40 999, где безусловное лидерство держит Индия. На страны СНГ приходится всего 754 таких инцидента.

Инфостилеры собирают самые разные данные: сведения о кредитных картах, реквизиты доступа к криптокошелькам, файлы cookies, историю браузеров и другую информацию, которая может храниться в браузерах на скомпрометированных системах, включая реквизиты доступа к ChatGPT.

Эти программы не отличаются избирательностью: их задача собрать как можно больше любой информации, представляющей ценность для киберкриминала, и отправить на контрольный сервер, где на последующих этапах будет проходить их сортировка. Иногда собранные таким образом данные продают в даркнете прямо неотфильтрованном виде, выделены лишь домены, найденные в логах, и информация об IP-адресе скомпрометированного хоста.

Именно такие массивы данных и изучали эксперты Group-IB, обнаружившие в логах инфостилеров обилие логинов и паролей к аккаунтам ChatGPT. В публикации Group-IB прямо не говорится о том, что на продажу выставлены именно данные из переговоров пользователей с чат-ботом, но при взломе их аккаунтов злоумышленники, как правило, получают доступ сразу ко всему.

| | Многие организации интегрируют ChatGPT в свои повседневные операционные процессы. Работники иногда делятся с ИИ-ботом секретной корреспонденцией или используют его для оптимизации проприетарного кода. Учитывая, что в своей стандартной конфигурации ChatGPT хранит содержимое всех диалогов, для злоумышленников это может означать кладезь важнейшей информации, для получения доступа к которой достаточно завладеть реквизитами к ChatGPT. Мы в Group-IB постоянно мониторим подпольные сообщества, чтобы своевременно выявлять такие аккаунты, сказал Дмитрий Шестаков, глава подразделения по разведке киберугроз в Group-IB.

| |

В Group-IB рекомендуют регулярно менять пароли к ChatGPT и внедрить двухфакторную авторизацию.

| | ChatGPT также позволяет отключить сохранение данных или вручную удалять логи переговоров с ним. Соответственно, оптимальной практикой будет сразу же удалять логи, где может присутствовать какая-то важная техническая или деловая информация, которая не должна попасть в чужие руки. Как можно заметить, решения некоторых крупнейших мировых компаний запретить использование ChatGPT из соображений безопасности оказалось здравым решением. отметила Анастасия Мельникова, директор по информационной безопасности компании SEQ.

| |

Эксперт добавила, что наблюдаемый рост интереса к чат-ботам будет неизбежно сопровождаться и ростом заинтересованности киберкриминала, и это коснётся отнюдь не только ChatGPT.

Мошенники в России начали использовать ChatGPT в фишинговых атаках

Мошенники в России начали использовать ChatGPT в фишинговых атаках. Об этом в середине июня 2023 года рассказала управляющий директор «Лаборатории Касперского» на территории РФ и стран СНГ Анна Кулашова.

| | Искусственный интеллект — это инструмент, и как любой инструмент он несет в себе как возможности, так и угрозы. И, конечно, он будет применяться со всех сторон, и в том числе мы уже видели атаки с использованием ChatGPT, - сообщила она в разговоре с «РИА Новости». | |

По словам Кулашовой, нейросеть используется для целевого фишинга при атаке на организацию. Таким действиям возможно противостоять, кроме того, применение подобных технологий остается дорогим к середине июня 2023 года.

| | Раньше можно было отличить фишинговое письмо по обычной грамотности речи: как только ты понимаешь, что письмо странно составлено, есть ошибки и так далее — значит, это фишинг. С применением ChatGPT ошибок в этих письмах стало гораздо меньше, — отметила управляющий директор «Лаборатории Касперского» на территории РФ и стран СНГ. | |

В компании T.Hunter подтверждают, что мошенники начали использовать ChatGPT для фишинга. Это позволяет автоматизировать процесс рассылки, повысить достоверность текстов и, соответственно, вероятность обмана пользователей, отмечают эксперты.

Ранее в 2023 году глава компании OpenAI, разработавшей чат-бот ChatGPT Сэм Олтмен, заявил, что сферу ИИ необходимо регулировать, поскольку если с технологией что-то «пойдет не так, все может пойти совсем не так». Он отметил, что, по мнению разработчиков, преимущества, которые дает ИИ, превышают риски, но обеспечение безопасности важно и для деятельности разработчиков.

Олтмен предложил создать агентство, которое бы лицензировало разработку крупных моделей ИИ, разрабатывало для них правила и тестирования.[7]

Применение ChatGPT все чаще приводит к утечкам важных данных

К маю 2023 года известно уже о нескольких случаев утечек данных из-за применение нейросети ChatGPT. В самой компании OpenAI, развивающей проект, подтвердили существование проблемы.

В марте 2023 года пользователи ChatGPT стали массово сообщать, что в их учетных записях отображаются истории чатов других людей. Более того, по информации издания PC Magazine, некоторые подписчики ChatGPT Plus также видели email-адреса других людей на своих страницах подписки.

В итоге разработчики OpenAI были вынуждены временно отключить эту функциональность, чтобы устранить ошибку. Сначала в компании сообщили, что причина сбоя была связана с неназванным опенсорсным ПО, используемым OpenAI, и подчеркнули, что из-за бага люди видели только заголовки чужих разговоров, но не их содержимое.

Впоследствии в OpenAI рассказали, что причиной сбоя и утечки данных ChatGPT стала ошибка библиотеки с открытым исходным кодом Redis. Утечка затронула данные 1,2% клиентов. Компания назвала этот показатель «крайне низким».

В апреле 2023 года стало известно о том, что корпоративное использование сотрудниками Samsung ChatGPT для решения служебных задач обернулось крупной утечкой данных. Южнокорейский производитель электроники задействовал искусственный интеллект для поиска проблем в исходном коде своих продуктов. Таким образом конфиденциальные данные попали в общий доступ, став частью собственной базы ChatGPT.

При этом, по мнению некоторых экспертов, киберинциденты с ChatGPT и другими чат-ботами ошибочно называть утечками данных. Дело в том, что в привычной терминологии утечки происходят из тех систем, данные в которых защищены. Но если пользователь передает конфиденциальную информацию на обработку в ChatGPT, это можно сравнить с выкладыванием тех же данных в публичную таблицу от Google.[8]

В Китае впервые произведен арест за фейковую новость, написанную ChatGPT

9 мая 2023 года стало известно о том, что в Китае произведён первый арест пользователя интернета, применявшего чат-бота ChatGPT на основе искусственного интеллекта для написания фейковых новостей.

Мужчина по фамилии Хун (Hong) подозревается в нарушении закона, который, в частности, запрещает неправомерное использование ИИ-сервисов и нейросетей для распространения ложной информации. По утверждениям правоохранительных органов, Хун посредством бота ChatGPT сгенерировал статьи с описанием железнодорожной катастрофы. В этих материалах говорилось, что в результате крушения поезда погибли пассажиры.

В общей сложности были обнаружены около 20 незначительно различающихся фальшивых заметок с указанием разных мест происшествия: меняя изложение, Хун обходил средства обнаружения повторяющегося контента. Все заметки были обнародованы на платформе блогов Baijiahao, которая принадлежит компании Baidu. В общей сложности эти фейковые новости набрали более 15 тыс. просмотров. Таким обманным способом подозреваемый зарабатывал деньги на трафике.

Подчёркивается, что ChatGPT заблокирован в КНР, но доступ к чат-боту можно получить через виртуальную частную сеть (VPN). Хун был арестован полицией провинции Ганьсу на севере центральной части Китая. Мужчина уже признался в незаконном использовании ChatGPT. Ему предъявлены обвинения в провоцировании конфликтов. Кроме того, мужчина может быть обвинён в нарушении общественного порядка и (или) создании беспорядков в общественных местах. Формулировка соответствующей статьи довольно расплывчата: она неоднократно подвергалась критике за то, что может задушить свободу слова в интернете и использоваться для ареста активистов, критикующих китайское правительство. Обвиняемым может грозить от пяти до десяти лет лишения свободы.[9]

Создание сервиса для голосового общения

Компания 3iTech (ООО «ДСС Лаб») 19 апреля 2023 года сообщила о создании сервиса, позволяющий устно общаться с ChatGPT на русском языке. Интеграция с ChatGPT выполнена в виде телеграм-чат-бота 3i Olivia. Подробнее здесь.

Внедрение в интернет-банке "Точки"

Банк Точка 19 апреля 2023 года сообщил о том, что внедрил GPT в поисковую строку интернет-банка. Сервис поможет предпринимателю получить ответы на самые распространённые и важные бизнес-вопросы. Подробнее здесь.

Использование в приложении Sunlight

7 апреля 2023 года компания SUNLIGHT сообщила о том, что начала генерировать release notes для своего мобильного приложения с помощью нейросети ChatGPT. Подробнее здесь.

Внедрение в сервис "Поинтер"

Сервис Поинтер 3 апреля 2023 года сообщил о том, что встроил чат-бот с искусственным интеллектом ChatGPT от компании OpenAI в свой функционал работы с отзывами. Теперь обработка обратной связи потребует меньше времени, а пользователи быстрее получат персонализированные ответы. Подробнее здесь.

Мошенники в России начали использовать ChatGPT для фишинга

Мошенники в России начали использовать ChatGPT для фишинга. Об этом в конце марта 2023 года рассказали специалисты по информационной безопасности компании T.Hunter. По словам экспертов, киберпреступники активно применяют возможности ИИ, для того чтобы повысить достоверность текстов, автоматизировать процесс и повысить вероятность обмана пользователей. Подробнее здесь.

Британская газета использовала ChatGPT для написания новостей и разочаровалась в результатах

Чат-бот ChatGPT на основе искусственного интеллекта, разработанный компанией OpenAI, пока не подходит на роль репортёра. Об этом, как стало известно в начале марта 2023 года, свидетельствуют результаты эксперимента, проведённого британской газетой.

Издание, пожелавшее остаться неназванным, выдало боту ChatGPT задание подготовить материал о жестоком ограблении пожилой женщины в Буэнос-Айресе. При этом, используя предоставленный исходный текст, требовалось добавить имена, указать конкретное место происшествия и вставить другие подробности.

Как отмечается, сгенерированная нейросетью новость на первый взгляд выглядела довольно сносно — особенно с учётом того, что искусственный интеллект самостоятельно придумал, как структурировать репортаж с острым вступлением, короткими предложениями и последовательным изложением, примерно соответствующим перевёрнутой пирамиде.

Но последующий анализ текста, выполненный редактором, выявил множество неточностей и сомнительных моментов. Оказалось, что ChatGPT некорректно указал имя и возраст жертвы, а также место преступления. В сгенерированной новости было указано, что преступник неизвестен и остаётся на свободе, но на деле он был идентифицирован и арестован. Вероятно, были сфабрикованы цитаты мэра Буэнос-Айреса (при указании имени которого была также допущена неточность) и детей пострадавшей. Кроме того, описание имеющегося видеоматериала не соответствовало кадрам.

В результате, газета пришла к выводу, что ChatGPT в текущем виде не подходит для написания полноценных новостей. С другой стороны, многие издатели рассматривают возможность использования этого чат-бота для генерации определённого контента с использованием строго контролируемого исходного материала. Это могла бы быть, например, обработка каких-либо статистических данных.[10]

В ВВС США рассказали, как ChatGPT поможет Пентагону

В конце февраля 2023 года ИТ-директор ВВС США Лорен Барретт Кнаузенбергер (Lauren Barrett Knausenberger) заявила, что с помощью чат-бота ChatGPT можно улучшить работу Министерства обороны США. В частности, по ее словам, искусственный интеллект способен упростить документооборот и синхронизацию задач между всеми военными подразделениями.

Кнаузенбергер считает, что ИИ может помочь быстро собрать воедино информацию, например, выяснить, кто отвечает за организацию в отдельно взятой операции. ChatGPT сможет выполнять обязанности сразу трех офицеров, занимающихся обработкой и анализом информации. Офицерам США же можно поручить другой фронт работ, что сэкономит значительное количество времени и сил для армии, пояснила она.

К началу марта 2023 года Кнаузенбергер собирается покинуть пост ИТ-директора ВВС США. Но перед уходом она обещает в 2023 году закончить проект по упрощению, автоматизации и комплексной синхронизации устройств, которыми пользуются военные в ее ведомстве. В том числе эта задача будет решена благодаря ИИ, а также интеграции функций чат-бота ChatGPT. ИТ-директор сообщает, что чем компьютерная инфраструктура становится шире, тем сложнее ею управлять и синхронизировать между устройствами.

Как пишет издание Defenseone, Пентагон до 2025 года планирует внедрить ИИ в такие проекты, как финансовый и аудиторский учет. ВВС США стремятся объединить свои различные службы вместе в одном стеке инструментов. А еще одна из насущных задач, которые попытаются решить за счет ИИ, – это оптимизировать входящий и исходящий трафик между всеми ведомствами на разбросанных по всему миру военных базах армии США.[11]

ОАЭ внедряют в школах онлайн-репетиторов на базе ChatGPT

В начале марта 2023 года министр образования ОАЭ Ахмед Белхул Аль Фаласи объявил о запуске онлайн-репетиторов на основе ИИ по всей стране в сотрудничестве с мировыми технологическими гигантами. Подробнее здесь.

Рост спроса на специалистов по ChatGPT в России в 13 раз

В России количество вакансий на HeadHunter, где требуется навыки работы с ChatGPT, в феврале 2023 года составило 38, что в 13 раз больше, чем месяцем ранее. Об этом рекрутинговый сервис сообщил в марте 2023 года.

Как пишут «Ведомости» со ссылкой на представителя HeadHunter, по ChatGPT основной наем идет у ИТ-компаний и компаний из финансового сектора, а в качестве специальностей указываются программисты, пиарщики, интернет-маркетологи и аналитики.

Самим разработчикам навык работы с ChatGPT и аналогичными площадками нужен редко, это навык прежде всего для «контентщиков, редакторов», сказал изданию эксперт в области рекрутмента и основатель сервиса Facancy Алена Владимирская. С помощью нейросетей пытаются делать боты, тексты, SEO-аналитику, добавила она.

На уровень зарплаты навык владения тем же ChatGPT, скорее всего, не повлияет, отмечает газета. Например, средняя зарплата копирайтера как с упоминанием чат-бота, так и без него, на hh.ru находится на уровне 30 000 рублей. Разработчик Центра искусственного интеллекта «СКБ Контур» Дмитрий Иванков отметил, что нужно различать сотрудников, умеющих работать с нейросетями в качестве разработчика (создавать, обучать и использовать нейросети при создании различных сервисов) и в качестве пользователя. Спрос на первых, по его словам, стабильно высокий, на вторую категорию работников он начал расти в 2022 году.

По данным HeadHunter, количество вакансий, где необходим навык работы с нейросетями, за полгода увеличилось на 62% - с 312 объявлений в августе 2022 года до 506 в феврале 2023-го. Также среди сервисов на основе нейросетей, с которыми должны уметь работать соискатели, чаще всего указываются приложение Colorize, которое раскрашивает черно-белые фотографии, а также DALL-E 2, Midjourney и Stable Diffusion, которые генерируют изображения, исходя из текстовых описаний.[12]

Появление платных API-интерфейсов

2 марта 2023 года компания OpenAI разрешила разработчикам интегрировать ChatGPT в сторонние приложения и сервисы через API. Первыми сторонними клиентами, которые воспользовались выпущенными API, стали компании Snap, Quizlet, Instacart и Shopify.

Стоимость использования API ChatGPT для интеграции в нейросетевые модели разработчиков составляет $0.002 за 1 тыс. токенов - это примерно 700 слов, говорится в блоге компании OpenAI.

| | Мы внимательно прислушались к отзывам наших разработчиков и усовершенствовали условия предоставления услуг API, чтобы лучше удовлетворить их потребности! Мы верим, что ИИ может предоставить невероятные возможности каждому, и лучший способ достичь этого — позволить каждому создавать что-то с его помощью, — сообщают разработчики из OpenAI. | |

По словам президента компании OpenAI Грега Брокмана, API основан на той же модели ИИ, что и версия ChatGPT «gpt-3.5-turbo». GPT-3.5 - это самая мощная модель генерации текста, которую OpenAI предлагает на март 2023 года; версия «turbo» более оптимизированная и отзывчивая.

По информации OpenAI, чтобы избежать некорректных и ложных ответов, компания внедрила язык разметки ChatML. Он передаёт текст API ChatGPT в виде последовательности сообщений вместе с метаданными. Кроме того, разработчики начнут чаще обновлять ChatGPT с выпуском «gpt-3.5-turbo». Это даст пользователям больше контроля над нагрузкой выделенных мощностей. Клиенты смогут использовать «gpt-3.5-turbo» с контекстным окном весом до 16 Кб, которые будут принимать в обработку в четыре раза больше токенов, чем стандартная модель ChatGPT. Это позволит вставлять целые страницы текста в вопросе и получать разумные ответы от модели.[13]

В работе ChatGPT используются 10 тыс. графических процессоров

ИИ-система ChatGPT была обучена на более чем 10 тыс. графических процессоров. Об этом в конце февраля 2023 года сообщил Дженсен Хуанг, генеральный директор компании Nvidia, чьи технологии используются в работе популярного чат-бота.

В рамках семинара в Школе бизнеса имени Уолтера Хааса Калифорнийского университета в Беркли Дженсен Хуанг поделился мыслями об этой разработке. Подобные системы ChatGPT, по его словам, требуют большой вычислительной мощности. ИИ на 2023 год уже предоставляет возможности для бизнеса производителям чипов GPU, в основном Nvidia, но AMD, Intel и Google также выпускают оборудование и ПО для поддержки рабочих нагрузок глубокого обучения. Подобные системы требуют большой вычислительной мощности.

Согласно заявлениям Хуанга, на март 2023 года для ИИ в основном используются графический процессор Nvidia A100 и платформа DGX A100, которые могут обеспечить производительность на уровне 5 петафлопс. Поэтому, если у AMD или другой компании не появится сильный конкурент для Nvidia, зеленая команда останется крупнейшим игроком в индустрии ИИ.

По словам Хуанга, преимущества этой технологии ChatGPT, заключается в том, что те сферы, которые ранее не могли воспользоваться ИИ, теперь смогут. Проводя дальнейшую аналогию, Хуанг заявил, что благодаря разработке ChatGPT теперь каждый фактически может стать программистом вне зависимости от своей профессии.

По данным TrendForce, количество параметров, используемых при обучении моделей ChatGPT в 2018 году, составило 120 млн, и число достигло уровня в 180 млрд в 2020 году. В опубликованном отчете, количество графических процессоров, необходимых модели ChatGPT для обработки данных обучения, достигло 10 тыс. В будущем количество графических процессоров, необходимых для коммерциализации модели ChatGPT, по оценкам, превысит 30 тыс. Однако точное количество GPU, используемых для обучения, будет зависеть от конкретной реализации и доступных ресурсов.[14]

Крупные корпорации начали использовать ChatGPT для маркетинга

В конце февраля 2023 года появилась информация о решении Coca-Cola использовать ИИ-инструментами и чат-ботами для маркетинговых и коммуникационных задач. В частности, речь идет о решениях ChatGPT, DALL-E и Codex. Подробнее здесь.

Старт продаж написанных нейросетью ChatGPT книг

В середине февраля 2023 года стало известно о том, что в интернет-магазине Amazon для заказа доступны книги, написанные чат-ботом ChatGPT на основе искусственного интеллекта.

Как сообщает Reuters, автором одного из таких проектов является Бретт Шиклер (Brett Schickler). По его словам, идея сгенерировать книгу появилась после запуска нейросети ChatGPT, которая способна формировать тексты на естественном языке. Шиклер, как отмечается, за считанные часы создал 30-страничную иллюстрированную детскую книгу под названием «Мудрая маленькая белка: история о сбережениях и инвестициях» (The Wise Little Squirrel: A Tale of Saving and Investing). Изображения для произведения также сгенерированы посредством ИИ.

Книга повествует о белке Сэмми, которая находит золотую монету и прячет её в копилке из жёлудя. После этого Сэмми открывает бизнес по торговле желудями и становится самой богатой белкой в лесу. Но это вызывает зависть у её друзей. Книга предлагается по цене $2,99 в электронной версии или $9,99 в печатной. Произведение принесло Шиклеру менее $100, но этого оказалось достаточно, чтобы вдохновить его на создание других книг с использованием искусственного интеллекта.

По состоянию на середину февраля 2023 года в магазине Amazon Kindle было более 200 электронных книг, в которых ChatGPT указан как автор или соавтор. Но из-за особенностей ChatGPT и того, что многие авторы не раскрывают информацию об использовании бота, практически невозможно оценить реальное количество произведений, написанных с применением этой нейросети.

| | ChatGPT, похоже, готов перевернуть устоявшуюся книжную индустрию, поскольку начинающие писатели, стремящиеся быстро заработать, обращаются к этому программному обеспечению для создания литературы. На YouTube, TikTok и Reddit появились сотни руководств, демонстрирующих, как сделать книгу всего за несколько часов, — отмечает Reuters.[15] | |

Запрет на использование для китайских ИТ-гигантов

22 февраля 2023 года стало известно о том, что регулирующие органы Китая запретили крупным технологическим компаниям предлагать услуги на базе чат-бота с искусственным интеллектом ChatGPT широкой публике.

Как сообщает Nikkei Asia, Tencent Holdings и Ant Group, а также финтех-филиал Alibaba Group Holding получили указание не предоставлять доступ к сервисам ChatGPT на своих платформах ни напрямую, ни через третьих лиц. ИТ-компаниям также придётся отчитываться перед регулирующими структурами о планах по запуску собственных услуг, аналогичных ChatGPT.

ИИ-бот ChatGPT, разработанный стартапом OpenAI, официально недоступен в Китае, но некоторые интернет-пользователи обходят ограничения посредством VPN. Кроме того, сторонними разработчиками выпущены десятки мини-программ для использования ChatGPT в WeChat от Tencent. Под давлением регулирующих органов Tencent приостановила работу нескольких таких сторонних сервисов независимо от того, были ли они подключены к ChatGPT или просто подражали этому ИИ-боту.

Введение новых правил, запрещающих ИТ-компаниям предлагать услуги с использованием ChatGPT, продиктовано официальной негативной реакцией в отношении чат-бота. В Пекине растёт тревога по поводу не прошедших цензуру ответов ChatGPT на запросы пользователей. По мнению регуляторов, этот сервис «может протянуть руку помощи правительству США в распространении дезинформации и манипулировании глобальными нарративами в собственных геополитических интересах».

| | Мы с самого начала понимали, что ChatGPT никогда не сможет проникнуть в Китай из-за проблем с цензурой, и КНР потребуются собственные версии бота, — сказал один из руководителей ведущей технологической компании. | |

После появления ChatGPT крупные китайские корпорации, включая Tencent, Alibaba и Baidu, поспешили обнародовать собственные планы по разработке аналогичных сервисов. Однако эти компании осторожно формулировали свои намерения, отмечая, что их услуги похожи на ChatGPT, но не интегрируют сам ChatGPT.[16]

Google представила конкурента чат-бота

6 февраля 2023 года Google представила чат-бота под названием Bard на основе искусственного интеллекта. Система, как ожидается, станет конкурентом сервиса ChatGPT, запущенного компанией OpenAI. Подробнее здесь.

В основе Telegram-бота для создания описаний товаров

6 февраля 2023 компания inSales сообщила о том, что на базе нейросети ChatGPT создала Telegram-бота, который на основе простого запроса может генерировать тексты для карточек товаров, которые продаются в интернет-магазинах и на маркетплейсах. Подробнее здесь.

Аудитория приложения - 100 млн пользователей

В январе 2023 года ChatGPT достиг отметки в 100 миллионов активных пользователей. На это потребовалось приблизительно 2 месяца[17].

Хакеры начали использовать нейросеть для создания вирусов

6 января 2023 года компания Check Point Research обнародовала результаты исследования, которое говорит о том, что злоумышленники, в том числе начинающие хакеры и люди без какого-либо опыта программирования, применяют передовую нейросеть ChatGPT для создания вредоносного кода.

Специалисты по кибербезопасности приводят несколько примеров использования чат-бота ChatGPT на основе искусственного интеллекта для генерации зловредов. В одном из таких случаев нейросеть написала код на Python с рядом криптографических функций: это, в частности, шифрование системных файлов с помощью алгоритмов Blowfish и Twofish. Теоретически такой код может лечь в основу программы-вымогателя. В другом случае нейросеть сформировала Python-скрипт для кражи информации: такой код способен искать определённые типы файлов, например, PDF, копировать их во временный каталог, сжимать и отправлять на сервер, контролируемый злоумышленниками.

Сообщается, что ChatGPT также может генерировать вредоносный код на других языках, например, Java. Злоумышленники проверяют способность нейросети создавать мошеннические чат-боты, предназначенные для обмана пользователей интернета. Другими сценариями злонамеренного использования ChatGPT могут стать формирование фишинговых сайтов и глубоко персонализированных веб-страниц, написание электронных писем определённого содержания и пр.

Киберпреступники даже продемонстрировали фрагмент кода, сгенерированный с использованием стороннего API, позволяющий получать актуальные цены на криптовалюты Monero, Bitcoin и Ethereum в рамках платёжной системы для рынка даркнета. Кроме того, нейросеть применялась для создания сценария торговой площадки, предназначенной для покупки и продажи украденных учётных записей, информации о кредитных картах, вредоносного кода и многого другого.[18]

Запрет на использование школах Нью-Йорка

6 января 2023 года стало известно о том, что Департамент образования Нью-Йорка запретил использование в школах чат-бота с искусственным интеллектом ChatGPT, разработанного компанией OpenAI.

В целом, нейросеть получила положительные отзывы, но некоторые эксперты усомнились в фактической точности выдаваемых ответов, а также начали говорить о проблемах, которые чат-бот может создать в некоторых сферах, в частности, в образовании. Преподаватели обеспокоены тем, что учащиеся начнут в массовом порядке использовать этот ИИ для выполнения домашних заданий, решения математических задач и написания эссе.

| | Хотя инструмент может дать быстрые и простые ответы на вопросы, он не развивает навыки критического мышления и решения проблем, которые необходимы для академического успеха и успеха на протяжении всей жизни, — сказала Дженна Лайл (Jenna Lyle), представительница Департамента образования Нью-Йорка. | |

В ответ на введённый запрет представитель OpenAI заявил, что компания «не хочет, чтобы ChatGPT применялся для вводящих в заблуждение целей в школах или где-либо ещё». С другой стороны, ряд работников сферы образования заявляют, что учреждениям необходимо будет найти способы интегрировать нейросети, такие как ChatGPT, в свои учебные программы, а не запрещать их полностью. Даже в случае запрета ChatGPT учащиеся смогут воспользоваться чат-ботом на своих персональных компьютерах. Кроме того, как отмечается, даже в школах ChatGPT может применяться тогда, когда это предусмотрено образовательной программой — например, при изучении современных ИИ-технологий.[19]

2022: Запуск ChatGPT

ChatGPT — это передовая нейросеть с широкими возможностями. Она была запущена 30 ноября 2022 года и сразу же привлекла внимание общественности.

Фундаментальные преимущества:

- Механизм внимания для взвешивания в неструктурированных массивах релевантные сегменты;

- Параллельная обработка – одновременная обработка всех токенов (основная базовая единица входной информации);

- Отсутствие рекуррентности, что позволяет избежать проблем, связанных с долговременными зависимостями в данных, а следовательно устраняет накопление ошибок в системе;

- Масштабируемость – позволяет быстро и эффективно обучаться на большом массиве данных.

ChatGPT базируется на применении трансформеров в NLP, методах обработки Big Data, глубоком обучении с активным применением обратного распространения ошибки и GAN методов и самое главное - контекстуальное понимание, т.е. способность учитывать широкий контекст входных данных на основе истории запросов.

Таким образом, успех ChatGPT – это объединение 8 признаков ИИ и 8 направлений ИИ одновременно:

- Генеративный ИИ

- NLP AI

- Cognitive AI

- Машинное обучение

- Глубокое обучение

- Predictive AI

- Decision AI

- Robotics AI (при необходимости).

2017: Google лидирует в разработках ИИ

Google лидировала в развитии ИИ и в 2017 году внедрила революционную на тот момент BERT, однако все лавры позже забрала на себя OpenAI, которая сумела технологические решения Google довести до ума, внедрив доступную и крайне эффективную модель.

Примечания

- ↑ [1]

- ↑ How we’re responding to The New York Times’ data demands in order to protect user privacy

- ↑ OpenAI Under Attack: CVE-2024-27564 Actively Exploited in the Wild

- ↑ AI Search Has A Citation Problem

- ↑ ChatGPT's odds of getting code questions correct are worse than a coin flip

- ↑ Минобороны требует запрета ChatGPT: Это оружие, загоняющее россиян в когнитивную ловушку

- ↑ Мошенники в России начали использовать ChatGPT, заявила эксперт

- ↑ OpenAI Confirms ChatGPT Data Breach

- ↑ Chinese authorities arrest ChatGPT user for generating fake news

- ↑ Journalists: ChatGPT is coming for your jobs (but not in the way you might think)

- ↑ Could the Pentagon Use a Little ChatGPT?

- ↑ Спрос на специалистов по ChatGPT вырос в 13 раз

- ↑ Introducing ChatGPT and Whisper APIs

- ↑ Update: ChatGPT runs 10K Nvidia training GPUs with potential for thousands more

- ↑ ChatGPT launches boom in AI-written e-books on Amazon

- ↑ China tells big tech companies not to offer ChatGPT services

- ↑ ChatGPT обогнал TikTok и стал самым быстрорастущим приложением в истории

- ↑ ChatGPT is enabling script kiddies to write functional malware

- ↑ ChatGPT banned from New York City public schools’ devices and networks

- ↑ Microsoft показала новый Bing с поддержкой ChatGPT и умными фишками на основе ИИ

| Заказчик | Интегратор | Год | Проект |

|---|---|---|---|

| - Coca-Cola Company | OpenAI, Bain & Company | --- |  |

| - Министерство образования ОАЭ (МoE) | OpenAI | --- |  |

| - PricewaterhouseCoopers (PwC) | OpenAI | --- |  |

| - Bluefocus Intelligent Communications | OpenAI, Alibaba Group, Baidu | --- |  |